La Inteligencia Artificial no está exenta de prejuicios humanos como el racismo

Los expertos están trabajando para evitar que lastime a y a los pobres.

Las nuevas tecnologías traen consigo grandes promesas y grandes problemas. Los teléfonos inteligentes pusieron el acceso al conocimiento infinito en nuestro bolsillos, pero condujeron al aumento de la adicción a la tecnología. Las plataformas de redes sociales que conectaron a miles de millones de personas se volvieron contra la democracia.

Y así sucede con la Inteligencia Artificial (IA), que podría cambiar fundamentalmente el mundo mientras contribuye a un mayor sesgo racial y a la exclusión.

Gran parte de la atención en cualquier inconveniente de la inteligencia artificial se ha centrado en cosas como el choque de los coches autónomos y el aumento de las máquinas que matan. O, como dijo el comentarista de 'CNN' Van Jones en una discusión sobre el tema la semana pasada, "¿Qué ha sido de Terminator?".

Pero muchos de los investigadores detrás de esta tecnología dicen que podría representar una mayor amenaza para la sociedad al impactar de forma adversa a los pobres, a los marginados y a la gente de color.

"Cada vez que la humanidad atraviesa una nueva ola de innovación y transformación tecnológica, hay gente herida y hay problemas tan grandes como el conflicto geopolítico", dice Fei Fei Li, director del Laboratorio de Inteligencia Artificial de Stanford. "La Inteligencia Artificial no es una excepción."

No se trata de cuestiones para el futuro, sino para el presente. La IA activa el reconocimiento de voz que hace que Siri y Alexa trabajen. Es la base de servicios útiles como Google Photos y Google Translate.

Ayuda a Netflix a recomendar películas, a Pandora a sugerir canciones y a los productos push de Amazon. Y es la razón por la que los coches autónomos pueden conducir por sí mismos.

Una parte de la IA es el aprendizaje automático, en el que un sistema analiza cantidades masivas de datos para tomar decisiones y reconocer patrones por sí mismo. Los datos deben ser cuidadosamente considerados para que no reflejen o contribuyan a los sesgos existentes.

"En el desarrollo de la IA, decimos basura dentro, basura fuera", señala Li. "Si los datos con los que empezamos son tendenciosos, nuestra decisión es tendenciosa."

Ya hemos visto ejemplos de esto. Un estudio reciente del M.I.T. Media Lab encontró que el software de reconocimiento facial tiene problemas para identificar a las mujeres de color.

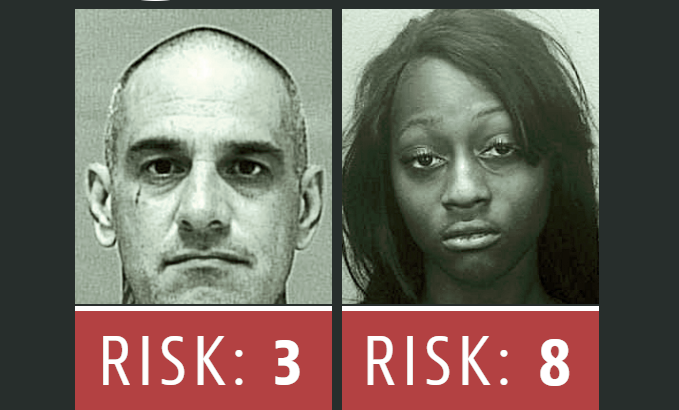

Las pruebas realizadas por 'The Washington Post' encontraron que los acentos a menudo hacen tropezar a los altavoces inteligentes como Alexa. Y una investigación de ProPublica reveló que el software utilizado para condenar a los criminales está sesgado en contra de los negros estadounidenses.

Abordar estos problemas será cada vez más urgente a medida que cosas como el software de reconocimiento facial se hagan más frecuentes en la aplicación de la ley, la seguridad fronteriza e incluso la contratación.

Muchos de los que se reunieron en la "Cumbre de IA - Diseñando un Futuro para Todos" ("AI Summit - Designing a Future for All"), dijeron que los nuevos estándares de la industria, un código de conducta, una mayor diversidad entre los ingenieros e informáticos que desarrollan IA, e incluso la regulación, contribuirían en gran medida a minimizar estos sesgos.

Los enfoques técnicos también pueden ayudar. La Herramienta de Equidad, desarrollada por Accenture, analiza los conjuntos de datos para encontrar cualquier sesgo y corregir modelos problemáticos.

"Una forma ingenua en que la gente pensaba en eliminar los sesgos en los algoritmos es simplemente: 'Oh, yo no incluyo el género en mis modelos, está bien. No incluyo la edad. No incluyo la raza", señala Rumman Chowdhury, quien ayudó a desarrollar la herramienta.

Pero los prejuicios no se crean únicamente alimentando un algoritmo de reconocimiento facial con una dieta de caras blancas.

"Todo científico social sabe que las variables están interrelacionadas", dice. "En los Estados Unidos, por ejemplo, el código postal está muy relacionado con los ingresos, muy relacionado con la raza. La profesión[está] muy relacionada con el género. Si ese es el mundo en el que quieres estar, ese es el mundo en el que estamos".

Diversificar los antecedentes de quienes crean la inteligencia artificial y aplicarla a todo, desde la policía hasta las compras y la banca, también contribuirá en gran medida a abordar el problema. Esto va más allá de diversificar las filas de ingenieros e informáticos que construyen estas herramientas para incluir a la gente que reflexiona sobre cómo se utilizan.

"Necesitamos tecnólogos que entiendan la historia, que entiendan la economía, que estén en conversaciones con filósofos", dice Marina Gorbis, directora ejecutiva del Institute for the Future (Instituto para el Futuro). "Necesitamos tener esta conversación porque nuestros tecnólogos ya no sólo están desarrollando aplicaciones, están desarrollando sistemas políticos y económicos."

Esas conversaciones, sostiene, son esenciales para asegurar que la IA haga más bien que mal.

Escribe tu comentario